近年、AI技術の進化に伴い、「AI対応ノートPC」という言葉を耳にする機会が増えています。これらのノートPCは、従来のモデルとは異なり、AI処理に特化したハードウェアを搭載し、私たちの生活や仕事をより快適にしてくれる可能性を秘めています。

ただ、「NPU」「GPU」「TPU」といった専門用語が出てくると、少し混乱しますよね。

「それぞれ何が違うの?」「自分にはどれが合っているの?」と迷うこともあるかと思います。

本記事では、そんな複雑に思えるキーワードについて、図を使って分かり易く解説します。

これからノートPCの購入を検討している方や、AI技術に興味を持ち始めた方は、是非本記事をご一読下さい。

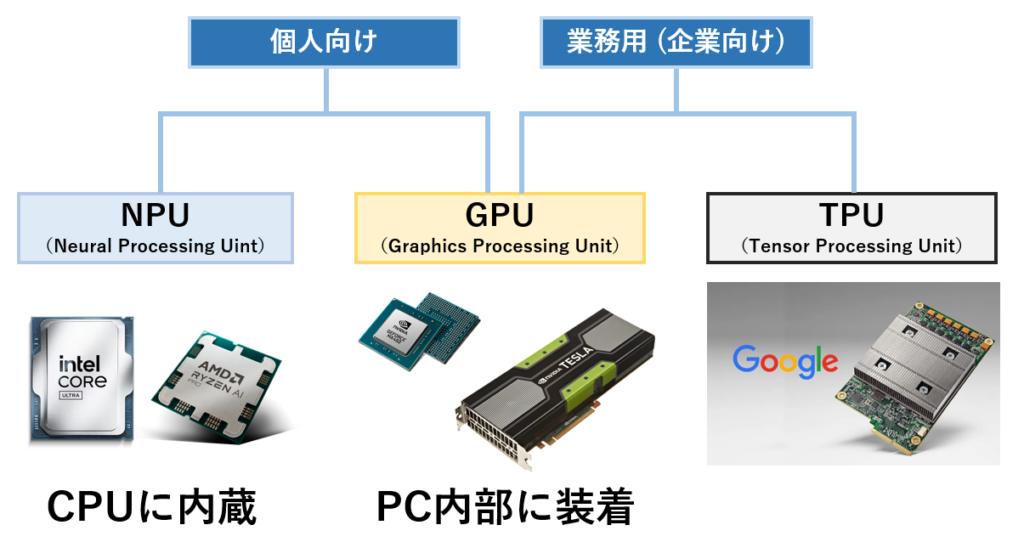

NPU、GPU、TPUの全体像

GPU(Graphics Processing Unit)、NPU(Neural Processing Unit)、TPU(Tensor Processing Unit)は、AI処理を効率よく行うための主要なデバイスの名称です。

CPUは複雑な計算を得意とするものの、コア数が少ないため大量の並列計算が苦手です。一方、NPU、GPU、TPUは数百~数万のコア数を持ち、単純計算の並列処理が効率よく行えます。

AI処理では膨大な計算が必要となるため、これらのデバイスが活用されています。

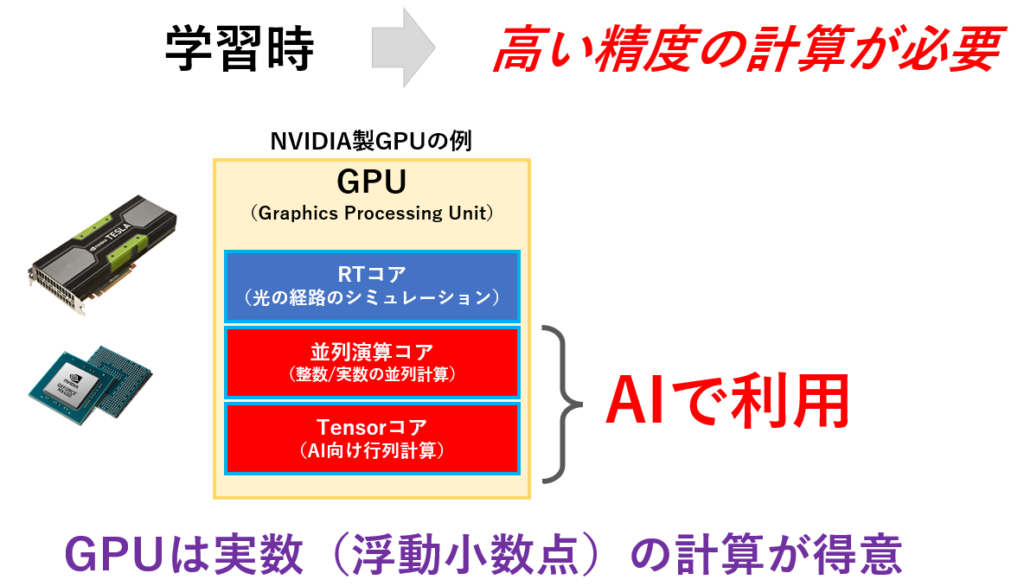

GPU(Graphics Processing Unit)

GPU (Graphics Processing Unit) は、もともとコンピュータグラフィックス(CADやゲームなど)の画像処理に特化して開発されたプロセッサです。しかし、その並列処理能力と実数計算が得意なアーキテクチャは、AI、特にディープラーニングの分野において非常に有効であり、AIのデバイスとして主流になっています。

- 並列処理能力

GPU は、多数のコアを搭載しており、複数の計算処理を同時に実行することができます。この並列処理能力は、AI の学習において大量のデータを高速に処理する上で非常に重要です。 - 実数計算が得意

ディープラーニングの学習では、浮動小数点数などの実数を用いた大規模な行列演算が頻繁に行われます。GPU は、このような実数計算が得意な演算器を多数搭載しており、CPU よりも高速に計算処理を実行できます。

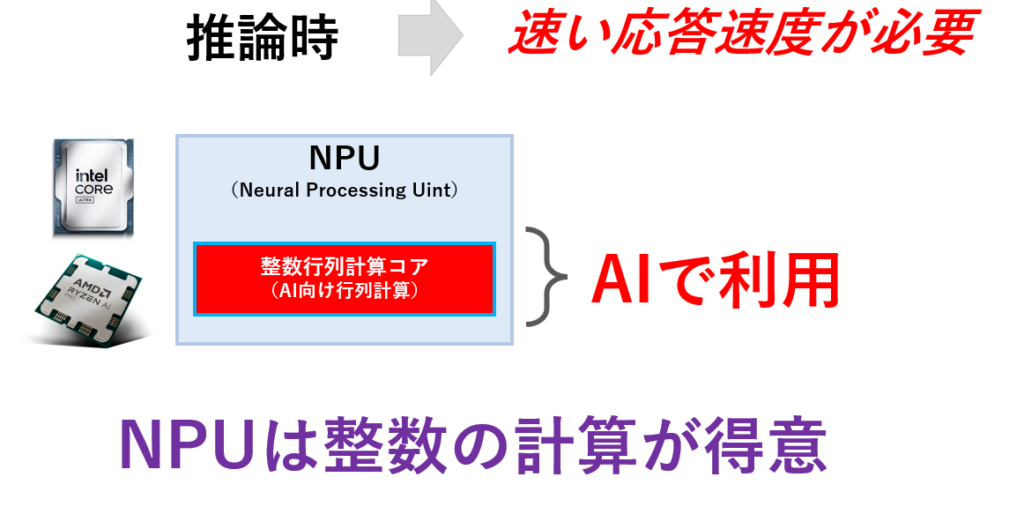

NPU(Neural Processing Unit)

NPU(Neural Processing Unit)は、AI処理に特化したプロセッサであり、特にニューラルネットワークの推論処理に最適化されています。CPUやGPUと比較して、より効率的にAI演算を実行できるのが特徴です。

NPU は、整数演算が得意な演算器を多数搭載しており、ディープラーニングの推論処理で多用される整数演算を高速に実行できます。これにより、消費電力を抑えつつ高い処理性能を実現しています。

- 並列処理能力

NPU は、多数のコアを搭載しており、複数の計算処理を同時に実行することができます。この並列処理能力は、AI の推論処理において大量のデータを高速に処理する上で非常に重要です。 - 整数演算が得意

ディープラーニングの推論では、整数演算が多用されます。NPU は、このような整数演算に特化した演算器を多数搭載しており、CPU や GPU よりも高速に計算処理を実行できます。 - 低消費電力

NPU は、CPU や GPU と比較して消費電力が低く、バッテリー駆動のデバイスでも長時間 AI 処理を実行することができます。

生成AIをはじめとするAI開発においては、学習精度を高めるために膨大な実数計算が必要となります。その一方、利用する際(推論時)は、実数を整数に丸めても性能の劣化がほぼ無いケースが多く、むしろリアルタイム性能が求められることから、整数演算に特化したNPUが登場しました。

TPU(Tensor Processing Unit)

TPU(Tensor Processing Unit)は、Googleが開発したAI専用のプロセッサであり、ディープラーニングの処理をより効率的に実行するために設計されています。特に、Googleのクラウドサービス「TensorFlow」に最適化されており、高速かつ低消費電力でAI処理を実行できます。

TPUは、特にGoogleのサービス(検索、翻訳、自動運転など)で活用されており、将来的には一般ユーザー向けデバイスにも組み込まれるかもしれませんが、現在のところ一般向けPCには搭載されていません。

NPUとは

NPUの性能評価はTOPS(Tera Operations Per Second)という数値を使います。

TOPSとは、1秒間に何兆回(Tera=10¹²)の整数演算を実行できるかを示す指標であり、10 TOPS のNPUなら、1秒間に10兆回の演算が可能です。

数値演算の性能指標として FLOPS(Floating-point Operations Per Second)がありあます。FLOPSは実数(浮動小数点)の性能指標であり、GPUではこちらが良く用いられます。NPUは整数演算に特化していることから、TOPSが用いられています。

下記はPC自由帳からの一部抜粋です。Copilot+PCの最小システム要件では、40TOPSのNPUが必要となるため、Intelだと Core Ultra 5 226V以上、AMDだと Ryzen AI 9 でないとスペックが満たせないことになります。

20万円台のノートPCの多くで採用されている Core Ultra 5 125H/125Uは、Copilot+PCに未対応なのでご注意ください。

INTEL公式ページの「級数」がシリーズ1はCopilot+PC未対応、シリーズ2はCopilot+PC対応となります。

| NPU内蔵CPU | TOPS性能 |

|---|---|

| Ryzen AI 9HX370 | 50 TOPS |

| Cora Ultra 9 288 | 48 TOPS |

| Core Ultra 7 266V/268 | 48 TOPS |

| Qualcomm Snapdragon X Elite | 45 TOPS |

| Qualcomm Snapdragon X Plus | 45 TOPS |

| Core Ultra 5 226V~238V | 40 TOPS |

| Apple M4 | 38 TOPS |

| Apple M3 | 18 TOPS |

| Ryzen 7 8840U | 16 TOPS |

| Intel Core Ultra 200Sシリーズ | 13 TOPS |

まとめ

本記事では、AI対応ノートPCに搭載されるNPU、GPU、TPUという主要なデバイスについて、その特徴や用途、そしてAI処理の効率化にどのように貢献しているかを解説しました。

GPUは、その優れた並列処理能力と実数計算の得意さから、特にディープラーニングの学習で広く利用されています。GPUメーカーとしては、NVIDIA、INTEL、AMDが有名ですが、AI用途においてはNVIDIAが主流です。

NPUは、AIの推論処理に特化したプロセッサであり、低消費電力で高い処理性能を実現することで、スマートフォンやノートPCなどのモバイルデバイスに最適です。主にインテルやAMD、Apple のCPUに内蔵されており、今後の主流になります。

TPUは、Google が開発したAI専用プロセッサであり、ディープラーニングの処理を効率的に行うために最適化されています。現時点ではGoogle のクラウドサービスでのみ利用可能です。

これらのデバイスは、それぞれ異なる強みを持ち、AI 処理の効率化に貢献しています。これからノートPCの購入を検討している方は、それぞれのデバイスの特性を理解し、自分のニーズに合った製品を選んでください。

この記事が、皆さんのAI対応ノートPC選びやAI技術理解のお役に立てれば幸いです。

コメント